AIUC-1: El Nuevo Estándar de Oro para IA Empresarial Confiable

Cerrar la brecha de confianza en CX: IA Responsable con AIUC-1

Imagine a una directora de CX, María, en una tensa videollamada con el CEO. "La semana pasada nuestro chatbot de IA identificó erróneamente a un cliente VIP y accidentalmente le envió por correo la lista de precios de un competidor", espeta el CEO. Los datos se han filtrado; la confianza del cliente está destrozada. En el caos resultante, TI culpa a producto, producto culpa a legal, y el equipo de marketing ni siquiera está seguro de qué pasó. María se da cuenta dolorosamente de que los equipos aislados y los despliegues acelerados de IA dejaron indefinidas las barreras críticas de datos y privacidad, y ahora la reputación de su marca pende de un hilo.

Este escenario no es ficción. A medida que los chatbots de IA, agentes de voz y motores de recomendación inundan los puntos de contacto con el cliente, los errores y las prácticas opacas de datos pueden destrozar la confianza de la noche a la mañana. Las empresas enfrentan un dilema claro: la IA promete hiperpersonalización y eficiencia, pero los errores (respuestas alucinadas, uso no autorizado de datos, filtraciones de propiedad intelectual) pueden dañar irreparablemente la experiencia del cliente. Los líderes de CX y EX necesitan un nuevo manual: un marco estructurado para gobernar la IA de manera responsable.

Perspectivas clave:

- Confianza en riesgo: Los fallos de la IA (como respuestas erróneas seguras o filtraciones de datos) erosionan directamente la confianza y lealtad del cliente. Las encuestas muestran que el 53% de los consumidores teme que sus datos personales sean mal utilizados por la IA, y casi la mitad compartiría más datos solo si las empresas proporcionan mayor transparencia y control.

- Primer estándar para agentes de IA: AIUC-1 es el primer estándar integral del mundo para agentes de IA, desarrollado por expertos en seguridad e IA para abordar preocupaciones a escala empresarial. Abarca dominios de riesgo centrales (Datos y Privacidad, Seguridad, Protección, Confiabilidad, Responsabilidad, Sociedad), creando una "infraestructura de confianza" común para la adopción de IA.

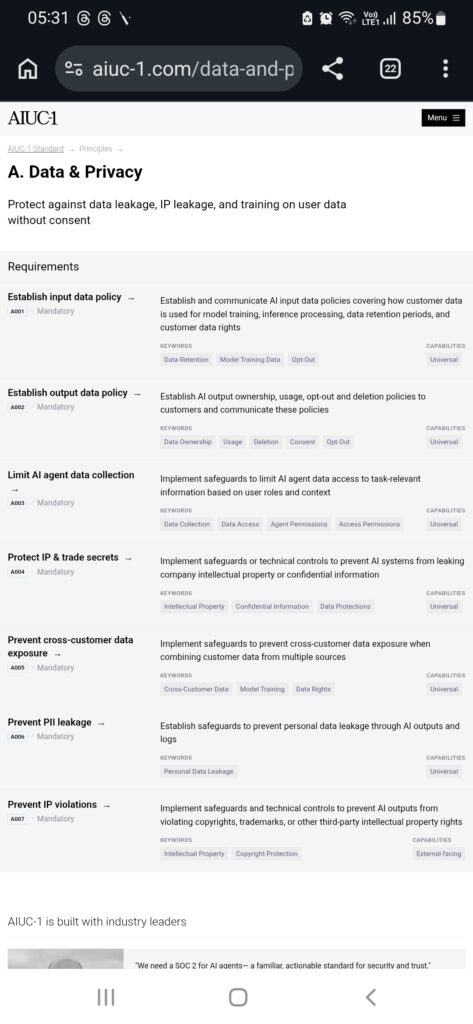

- Controles obligatorios de datos/privacidad: AIUC-1 impone requisitos estrictos de datos y privacidad. Por ejemplo, requiere políticas claras de datos de entrada/salida, límites en la recopilación de datos y salvaguardas técnicas contra la filtración de información personal identificable o secretos comerciales. Estas barreras de protección tienen como objetivo prevenir incidentes como el que acaba de experimentar la empresa de María.

- Certificación y seguro: La certificación AIUC-1 significa que un sistema de IA ha sido sometido a pruebas rigurosas (miles de simulaciones de fallos en escenarios de riesgo). Los primeros adoptantes como ElevenLabs han obtenido certificados AIUC-1 e incluso seguro de IA para sus agentes de voz, señalando a clientes y socios que su IA está verificada.

- La colaboración es clave: AIUC-1 fue construido por líderes de Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs y otros, reflejando un consenso de que la seguridad/protección de la IA requiere acción multifuncional. Marcos como el Ciclo de Vida de Desarrollo Seguro de Microsoft para IA enfatizan de manera similar que la seguridad debe ser una forma de trabajar, no una casilla de verificación.

- Trampas del "lavado de IA": Muchos proveedores pegan "IA" en productos sin datos reales o salvaguardas, pero los clientes ven rápidamente a través de esto. Las afirmaciones exageradas (como "IA de nivel empresarial" sin procedencia de datos) conducen a resultados inconsistentes que erosionan la confianza e impulsan la rotación. Peor aún, los reguladores están tomando medidas enérgicas: la SEC y la FTC han multado a empresas por afirmaciones engañosas sobre IA.

Trampas comunes: Los líderes de CX deben tener cuidado con...

- Lavado de IA: Desplegar bots de IA "no supervisados" sin nuevos datos o modelos. Los clientes ven rápidamente cero mejoras, lo que daña la credibilidad de la marca.

- Exceso de datos: Acumular datos de clientes "por si acaso", sin políticas claras, conduce a violaciones de privacidad. Como aconseja Qualtrics, "Deja de recopilar todo por el simple hecho de tenerlo"; recopilar solo lo que necesitas (con consentimiento y propósito claro) genera confianza.

- Gobernanza aislada: Tratar la IA como una herramienta puramente de ingeniería mientras se ignora la seguridad, entrada legal y de CX. Si los equipos no colaboran sobre los riesgos de IA (como advierte Microsoft), surgen brechas de confianza en los puntos de contacto con el cliente.

- Omitir pruebas adversarias: Lanzar funciones de IA generativa sin pruebas adversarias o monitoreo. Sin salvaguardas en capas (como filtros de indicaciones o detección de anomalías), las salidas de IA pueden filtrar información personal identificable, alucinar o violar la propiedad intelectual.

- Descuidar estándares: No alinearse con marcos emergentes de IA (por ejemplo, AIUC-1, MITRE ATLAS) deja a las empresas sin preparación para auditorías o seguros. El resultado son proyectos estancados, riesgo legal y pérdida de lealtad del cliente.

- Uso opaco de IA: No informar a los clientes cuándo la IA está en uso o cómo se utilizan sus datos. Este enfoque de "caja negra" se percibe rápidamente como desconfianza; la transparencia no es negociable en la era de la IA generativa.

¿Qué es AIUC-1 y por qué es importante para CX?

AIUC-1 es el primer marco estándar de la industria específicamente para agentes de IA, que cubre datos/privacidad, seguridad, protección y más. Codifica las mejores prácticas (y controles técnicos) para que las empresas puedan medir y gestionar el riesgo de IA de manera consistente. En términos prácticos, AIUC-1 brinda a los equipos de CX un lenguaje común para evaluar cualquier solución de IA: "¿Es este agente seguro, confiable y respetuoso con los datos del cliente?" Al estandarizar esas respuestas, AIUC-1 construye la infraestructura de confianza que desbloquea la adopción empresarial de IA.

¿Cómo crean los problemas de datos y privacidad una brecha de confianza?

La confianza del cliente se destroza en el momento en que un agente de IA hace un mal uso de datos personales o filtra información confidencial. Los sistemas modernos de IA se basan en datos dispersos y tienen "memoria probabilística", lo que significa que pueden revelar accidentalmente información personal identificable o propiedad intelectual a menos que estén estrictamente controlados. Por ejemplo, un bot de IA que sin saberlo entrena con entradas de CRM podría regurgitar detalles confidenciales del cliente abiertamente. Los expertos en CX advierten que tales filtraciones, o incluso comportamiento impredecible a medida que los modelos de IA se actualizan, socavan directamente la experiencia del cliente. En industrias reguladas, esto también invita a problemas legales y de cumplimiento.

AIUC-1 combate estos riesgos al exigir políticas y controles de datos claros. Obliga a los equipos a definir cómo se utilizan y protegen los datos de entrada (A001), qué salidas puede generar la IA y quién las posee (A002), y a limitar la recopilación de datos a lo que es relevante para la tarea (A003). Estos pasos aseguran que los datos personales o corporativos de un cliente no sean consumidos o retenidos por la IA sin supervisión. En resumen, una gobernanza clara de entrada/salida y controles de acceso son la primera línea de defensa contra el mal manejo de la información del cliente.

¿Qué controles de datos y privacidad impone AIUC-1?

AIUC-1 enumera varios requisitos obligatorios para asegurar el uso de datos en sistemas de IA. Los ejemplos clave incluyen: establecer políticas de datos de entrada (cómo y cuándo se utilizan los datos del cliente para entrenamiento o inferencia, y retención/derechos de datos); formalizar políticas de datos de salida (definir quién posee los datos generados por IA, derechos de uso, procesos de exclusión y eliminación); y limitar la recopilación de datos de IA estrictamente a entradas relevantes para la tarea según roles.

Crucialmente, AIUC-1 también exige salvaguardas técnicas: evitar que la IA filtre propiedad intelectual de la empresa o secretos comerciales (A004); bloquear cualquier mezcla de datos entre clientes cuando una IA tiene entradas multiusuario (A005); detener filtración de información personal identificable a través de salidas o registros (A006); y asegurar que las salidas de IA no violen derechos de autor o marcas comerciales de terceros (A007). En conjunto, estos controles convierten objetivos abstractos de privacidad en verificaciones concretas: auditar conjuntos de datos, cifrar registros, aislar modelos y aplicar revisiones similares a DPIA. Para los líderes de CX, el resultado es medible: políticas y herramientas que muestran a los clientes "nuestra IA no abusará de sus datos ni de los de nadie más".

¿Cómo reconstruye la certificación AIUC-1 la confianza?

Un certificado AIUC-1 significa que un agente de IA ha superado más de 5 000 simulaciones adversarias en escenarios de seguridad, privacidad y protección. En efecto, es un sello de terceros de que "esta IA está probada y es segura". Para clientes y socios, eso es poderoso. ElevenLabs informa que obtener AIUC-1 les permitió asegurar sus agentes de voz de IA como empleados, cubriendo errores desde alucinaciones hasta filtraciones. Como explica el cofundador de AI Underwriting, "las aseguradoras líderes tienen tanta confianza en este enfoque basado en certificación que están ofreciendo cobertura financiera específica de IA a quienes la obtienen. ElevenLabs es la primera empresa en demostrar que este modelo funciona a escala".

En la práctica, certificación + seguro transfiere el riesgo. En lugar de temer lo desconocido ("¿Qué pasa si nuestro chatbot se descontrola?"), las empresas pueden trasladar la responsabilidad al marco: si la IA aún falla a pesar de las barreras de AIUC-1, la pérdida está cubierta. Esto elimina una enorme barrera psicológica para usar IA en flujos de trabajo centrales. Como señala el cofundador de ElevenLabs, AIUC-1 (y el seguro que desbloquea) acelera el despliegue empresarial al brindar a los socios "el marco de seguridad y la cobertura de seguro de IA que necesitan". Para los líderes de CX/EX, eso significa más proyectos piloto graduándose a producción y un punto de venta más fuerte al construir confianza con el cliente.

¿Cómo pueden los líderes de CX/EX prepararse para una IA responsable?

Comience con gobernanza y políticas, no solo tecnología. Defina sus reglas de uso de datos ahora: decida qué datos de clientes alimentarán los modelos de IA, cuánto tiempo se almacenan y cómo los usuarios pueden optar por no participar. Involucre equipos multifuncionales temprano (legal, seguridad, ciencia de datos y producto), reflejando el enfoque SDL de Microsoft que trata la seguridad como un principio de diseño colaborativo. A continuación, exija transparencia tanto internamente como para los clientes. Por ejemplo, siga el ejemplo de Microsoft al revelar claramente cuándo un usuario está interactuando con IA y darles control sobre sus datos.

Adopte estándares como AIUC-1 como una estrella del norte. Use su lista de verificación de datos/privacidad para auditar proveedores de IA y proyectos internos: ¿estamos limitando la recopilación de datos? ¿cifrando registros? ¿evitando la inferencia de información personal identificable? Si no, invierta en esos controles ahora. Involucre a un auditor acreditado para delimitar sus activos de IA: el consorcio AIUC-1 ofrece orientación sobre dónde se aplica cada control. Considere pilotear la certificación para agentes de IA clave; por ejemplo, los bots de voz o ventas a menudo aparecen primero en las transformaciones de CX. Como muestra el ejemplo de ElevenLabs, integrar salvaguardas incorporadas puede acelerar la certificación: uno de sus clientes certificó un bot de voz de consulta de propiedades 24/7 en solo cuatro semanas.

Finalmente, mida e itere sobre la retroalimentación del cliente. Monitoree de cerca las interacciones impulsadas por IA: ¿los clientes están abandonando o presentando quejas después de un punto de contacto de IA? Use métricas de CX para detectar problemas que las pruebas de IA podrían perder. Y recuerde, la confianza se gana con el tiempo: como dice un experto de Qualtrics, el valor real de la IA proviene de "construir conexiones y mejorar la experiencia humana, con agentes de IA capaces gestionando tareas simples y asistiendo a agentes humanos en problemas complejos". Mantenga humanos en el circuito donde más importa y deje que la IA maneje el resto dentro de sus nuevas barreras de gobernanza.

Preguntas frecuentes

¿Qué es exactamente AIUC-1?

AIUC-1 es un nuevo estándar de la industria y marco de certificación para "agentes" de IA (bots de software y asistentes) que cubre todas las categorías principales de riesgo. Fue creado por expertos de empresas como Microsoft, Cisco, JPMorgan Chase, UiPath y ElevenLabs para dar a las empresas un marco claro (como un "SOC 2" para IA) al evaluar sistemas de IA. Al cumplir con los requisitos de AIUC-1, un producto de IA demuestra que ha sido probado para seguridad, privacidad de datos, confiabilidad y otras preocupaciones.

¿Qué problemas de datos y privacidad aborda AIUC-1?

El estándar exige controles específicos sobre el uso de datos: establecer políticas escritas para datos de entrada y salida de IA (incluido entrenamiento, retención, eliminación y exclusión del cliente); restringir a la IA de acceder a datos irrelevantes o excesivos; y agregar salvaguardas contra la filtración de datos personales, propiedad intelectual o mezcla de datos de diferentes clientes. En resumen, obliga a las organizaciones a asegurar cómo fluyen los datos de los clientes a través de su IA, previniendo los tipos de violaciones de privacidad que destruyen la confianza.

¿Cómo reconstruye la certificación AIUC-1 la confianza del cliente?

Obtener la certificación AIUC-1 (y estar asegurado) señala a los clientes que el sistema de IA ha pasado pruebas rigurosas contra modos de fallo conocidos. Es como mostrar un informe de inspección de seguridad para su IA. Las empresas pueden entonces decir honestamente a los clientes: "Nuestra IA tiene salvaguardas verificables e incluso cobertura de seguro". Los primeros adoptantes informan que esta credibilidad acelera contratos y despliegue. En la práctica, la certificación significa menos errores que afectan a la marca, y si ocurre un incidente a pesar de la certificación, el seguro puede cubrir las consecuencias. Este bucle de responsabilidad es lo que convierte la IA de una apuesta desconocida a un servicio gestionado a los ojos de líderes empresariales y clientes por igual.

¿Qué sucede si omitimos estos estándares?

Ignorar la gobernanza de IA abre las compuertas de la confianza. Sin políticas o pruebas claras, los agentes de IA pueden filtrar datos, violar derechos de autor o dar consejos peligrosamente malos. Los clientes lo notarán: por ejemplo, los bots que dan respuestas inconsistentes o engañosas erosionarán la lealtad. Los reguladores y la industria también están endureciendo la supervisión. Las empresas que hacen "lavado de IA" (pretenden usar IA sin controles adecuados) corren el riesgo de acciones legales: la SEC y la FTC ya han sancionado a empresas por afirmaciones engañosas sobre IA. En resumen, omitir estándares significa arriesgar daño a la marca, multas de cumplimiento y pérdida de clientes.

¿Cómo pueden los líderes de CX comenzar a adoptar prácticas AIUC-1?

Comience por inventariar sus herramientas de IA y flujos de datos: clasifique qué sistemas manejan datos de clientes o interactúan con clientes, y compárelos con la lista de verificación de controles de AIUC-1. Desarrolle o actualice su política de privacidad de datos de IA (que cubra entrada, salida, retención y derechos del cliente). Trabaje con sus equipos de seguridad y legal para implementar los controles técnicos necesarios (por ejemplo, minimización de datos, cifrado, monitoreo). Involucre a un auditor acreditado de AIUC-1 temprano para delimitar la certificación. Incluso si la certificación completa es un objetivo a largo plazo, use los requisitos del estándar como un análisis de brechas para fortalecer sus sistemas de IA ahora. Finalmente, siga comunicándose con las partes interesadas (y clientes) a medida que mejora: la transparencia sobre estos esfuerzos ayudará en sí misma a reconstruir la confianza en sus iniciativas de IA.

Conclusiones prácticas:

- Defina políticas de datos claras: Escriba cómo la IA utilizará los datos del cliente para entrenamiento vs. inferencia, establezca límites de retención y ofrezca derechos de exclusión/eliminación.

- Adopte AIUC-1 como marco: Use sus principios para unificar verificaciones de seguridad, privacidad y protección en todos los proyectos de IA. Considere pilotear la certificación para agentes de IA de alto riesgo.

- Colabore entre equipos: Rompa silos involucrando a TI, legal, cumplimiento y CX en las decisiones de despliegue de IA. Trate la gestión de riesgos de IA como una misión compartida.

- Incorpore seguridad por diseño: Antes del lanzamiento, pruebe los agentes de IA bajo estrés (pruebas adversarias, inyecciones de indicaciones) e implemente barreras de protección en tiempo de ejecución (modulación, alertas de anomalías) para prevenir filtraciones o mal comportamiento.

- Aproveche el seguro de IA: Busque proveedores de IA con certificación AIUC-1 o respaldo de seguro. Esto alinea incentivos y proporciona protección financiera si la IA se equivoca.

- Sea transparente con los usuarios: Informe a los clientes cuándo se usa IA y hágales saber cómo se manejan sus datos, basándose en la práctica de Copilot de Microsoft de divulgaciones en tiempo real.

- Recopile solo los datos necesarios: Favorezca la calidad sobre la cantidad. A medida que los usuarios demandan privacidad, recopile solo la información requerida para el servicio y explique claramente cómo mejora su experiencia.

- Capacite y monitoree al personal: Asegúrese de que los equipos de cara al cliente comprendan las limitaciones de la IA y tengan rutas de escalamiento claras. Rastree las métricas de CX después del despliegue de IA para detectar problemas (como respuesta lenta o insatisfacción) temprano.

Al abordar los riesgos de IA de frente y adoptar marcos como AIUC-1, los líderes de CX y EX pueden cerrar la brecha de confianza. En un panorama de viajes fragmentados y rápida evolución de la IA, así es como las empresas pasan de la experimentación cautelosa al despliegue de IA seguro y centrado en el cliente.

La publicación AIUC-1: The New Gold Standard for Trustworthy Enterprise AI apareció primero en CX Quest.

También te puede interesar

¡Será el ideal! Así estará el clima para ver a Shakira en el Zócalo de la CDMX

La 'fantasía' de ataque de Trump a Irán está a punto de desatar 'total anarquía y caos': análisis